블록체인 X AI, 반드시 알아야 할 6가지 인프라 프로젝트

프로젝트의 등장 배경, 주요 서비스, 투자 연혁, 팀 백그라운드, 그리고 향후 TGE 대비 전략까지 살펴보기

0. 들어가며

AI 기술의 발전이 가속화되면서, 인공지능은 일상생활과 산업 전반에 걸쳐 점점 더 깊숙이 자리 잡고 있습니다. 이에 따라 AI에 대한 수요는 기하급수적으로 증가하고 있으며, 특히 대규모 연산을 처리하는 데 필수적인 GPU에 대한 의존도 역시 높아지고 있습니다. 최근 SNS에서 화제를 모은 ChatGPT의 이미지 생성 기능이 업데이트된 직후, 과도한 GPU 수요로 인해 무료 계정 사용자들이 하루 3회로 이미지 생성이 제한되었던 사례는 이러한 문제를 단적으로 보여줍니다.

it's super fun seeing people love images in chatgpt.

— Sam Altman (@sama) March 27, 2025

but our GPUs are melting.

we are going to temporarily introduce some rate limits while we work on making it more efficient. hopefully won't be long!

chatgpt free tier will get 3 generations per day soon.

그러나 현재 GPU 시장은 소수의 빅테크 기업들이 지배하고 있어 높은 비용과 접근성 제한이라는 구조적 문제가 존재합니다. AI 기술이 더욱 발전할수록 GPU에 대한 수요는 더욱 증가할 것으로 예상되지만, 현재의 중앙화된 시장 구조는 혁신과 확장을 저해하는 주요 방해물로 작용할 가능성이 높습니다.

이러한 한계를 극복하기 위한 대안으로 블록체인과 AI를 결합한 탈중앙화 인프라 프로토콜들이 최근 주목받고 있습니다. 이들은 전 세계에 분산된 유휴 GPU 자원을 통합하여 기존의 중앙화 인프라 비효율 문제를 해결하고, AI 생태계의 확장성과 효율성을 높이는 데 중점을 두고 있습니다.

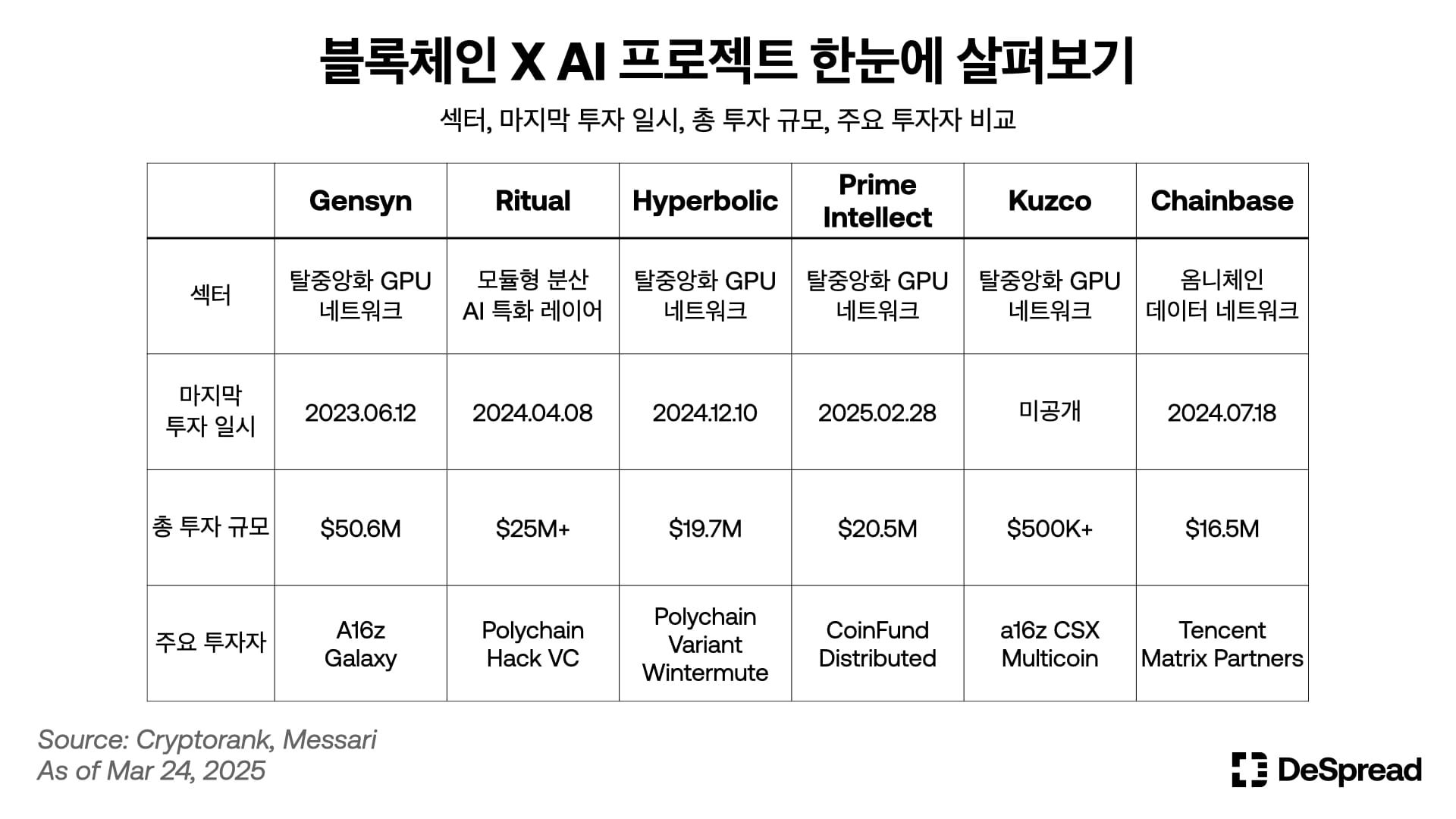

본 아티클에서는 이 중에서도 대규모 투자, 탄탄한 팀 백그라운드, 독창적인 프로덕트를 앞세워 현재 시장에서 많은 주목을 받고 있는 6개의 프로젝트의 등장 배경과 주요 서비스, 투자 히스토리, 팀 연혁, 그리고 향후 TGE에 대비한 전략에 대해 살펴보고자 합니다.

1. Gensyn

겐신(Gensyn)은 머신러닝 모델 학습에 필요한 대규모 연산 자원을 탈중앙화 방식으로 제공하는 레이어 1 블록체인입니다. AI 학습용 컴퓨팅 파워 시장은 향후 수년 내에 글로벌 GDP의 1%를 차지할 만큼 빠르게 성장할 것으로 예측되지만, 현재는 AWS, Azure 등 소수의 대형 클라우드 기업이 시장을 독점하고 있어 비용과 접근성 측면에서 한계가 뚜렷합니다.

겐신은 이러한 구조적 문제를 해결하고자 “머신 인텔리전스를 위한 네트워크(The network for machine intelligence)”라는 비전 하에, 누구나 유휴 GPU 자원을 네트워크에 기여하고 스마트 컨트랙트를 통해 신뢰 없이 보상받을 수 있는 시스템을 제시하고 있습니다.

1.1. 주요 서비스 및 성과

높은 확장성 및 낮은 비용

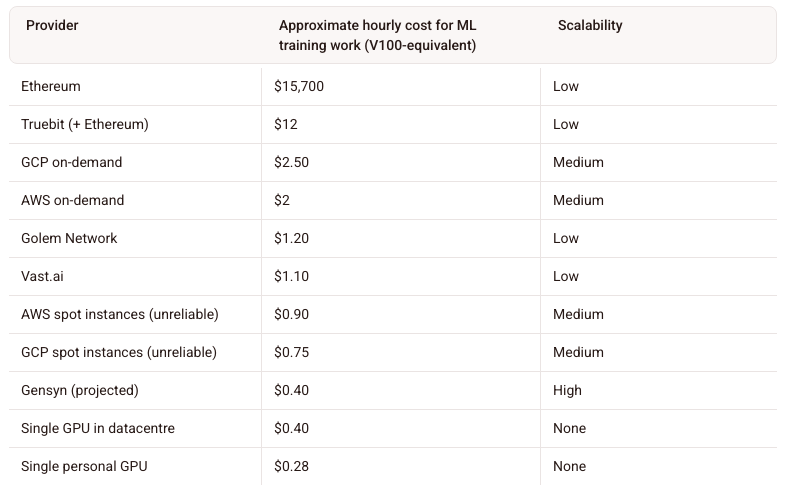

겐신 네트워크는 Parity Substrate 기반의 PoS 체인으로 구축되었으며, 확장성과 비용 측면에서 기존 솔루션 대비 경쟁 우위를 확보하고 있습니다. 특히 겐신의 핵심 기술은 작업 검증 메커니즘으로, 여러 기기가 수행한 복잡한 머신러닝 연산을 특정 주체에 대한 신뢰에 의존하지 않고도 검증 가능하도록 하며, 또한 동일 작업에 대한 불필요한 중복 계산 없이 무결성을 확보합니다.

유휴 GPU 자원의 활용과 비용 혁신

겐신은 전 세계에 분산된 유휴 GPU 자원을 하나의 거대한 클러스터로 통합하여 제공함으로써, AWS 등 기존 클라우드 인프라 대비 GPU 연산 비용을 최대 80% 절약할 수 있다고 밝히고 있습니다. 또한, 사용자는 실제로 수행한 연산 작업에 대해서만 비용을 지불하면 되기 때문에 더욱 합리적으로 GPU를 사용할 수 있습니다.

지속적인 연구 개발과 전략적 파트너십

겐신은 분산 연산 최적화를 위한 내부 기술 개발뿐 아니라, 다양한 외부 파트너와의 협업을 통해 AI 학습 인프라 전반의 효율을 제고하고자 하는 전략을 취하고 있습니다. 공식 블로그를 통해 공개된 주요 연구 성과는 다음과 같습니다:

- RL Swarm: 분산 강화학습을 위한 프레임워크

- Verde: 무신뢰 노드 수준에서의 머신러닝 검증 시스템

- SkipPipe: 탈중앙화된 환경에서의 통신 효율 최적화 알고리즘

- Diverse Expert Ensembles: 이종 전문가 모델 병렬 조합 프레임워크

겐신은 AI 모델 학습에 필요한 세 가지 핵심 요소인 연산, 데이터, 레이블링 중 ‘연산’ 영역을 담당하고, 나머지 데이터와 레이블링 영역은 외부 프로토콜과의 연구 및 제휴를 통해 보완한다는 개방형 전략을 추구하고 있습니다. 이러한 생태계 중심 접근은 겐신이 탈중앙화 AI 인프라 레이어로 자리 잡는 데 있어 중요한 기반이 될 것으로 기대됩니다.

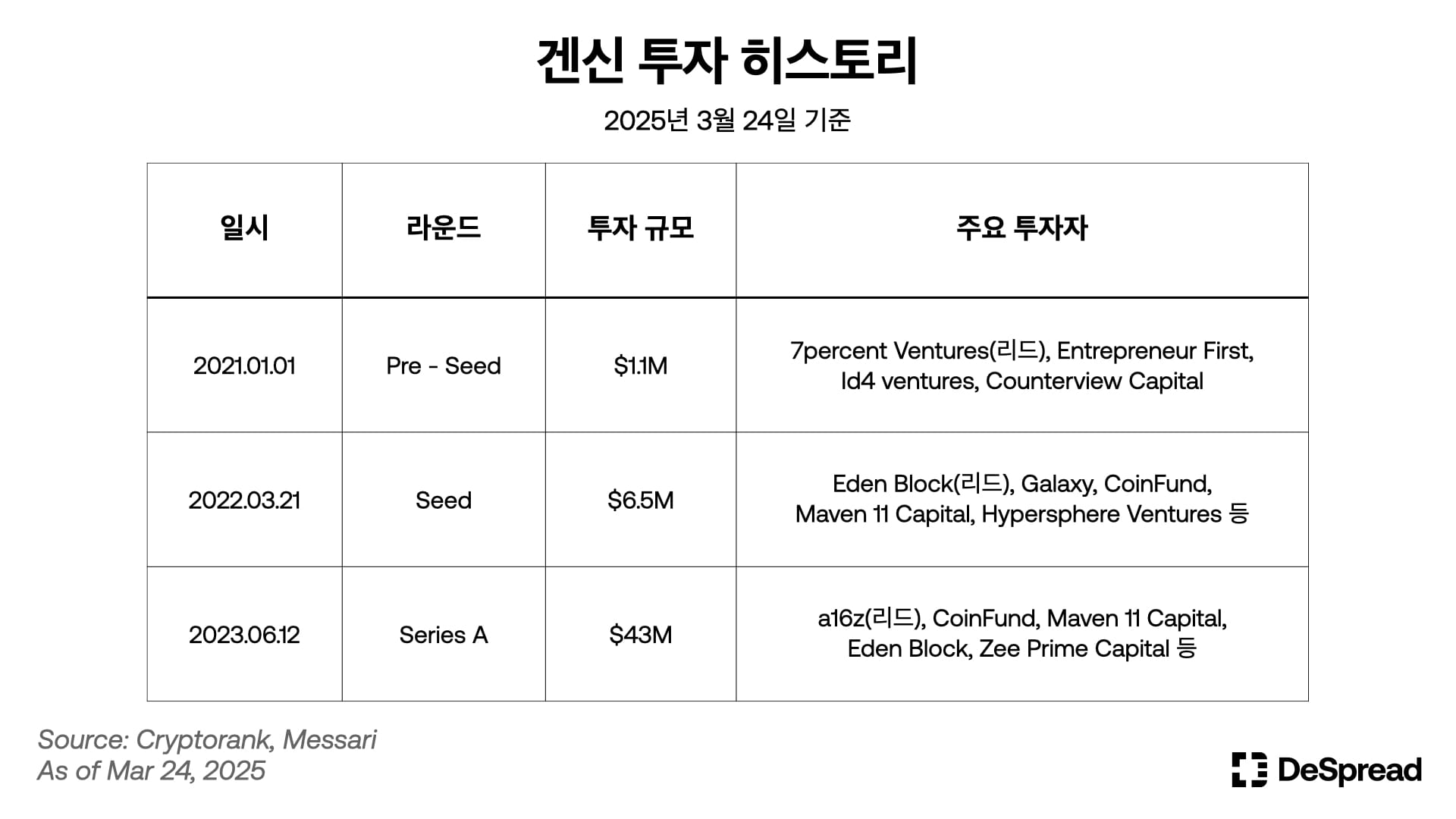

1.2. 투자 히스토리

겐신은 현재까지 총 세 차례의 투자 라운드를 통해 약 $50.6M의 자금을 유치하였습니다. 이 중 가장 주목할 만한 라운드는 a16z가 리드한 $43M 규모의 시리즈 A 라운드로, 겐신이 웹3 기반의 분산 컴퓨팅 네트워크 중에서도 단연 돋보이는 프로젝트로 부상하는 계기가 되었습니다.

1.3. 팀 백그라운드

Harry Grieve, 코파운더 & CTO

Ben Fielding, 코파운더 & CEO

- Northumbria Unviersity 컴퓨터과학 박사

- 데이터 프라이버시 스타트업 Fair Custodian 창업

- VC 및 사모펀드인 Entrepreneurs First를 통해 Harry Grieve와 겐신 공동 창업

- 트위터 / 링크드인

1.4. TGE 대비 전략

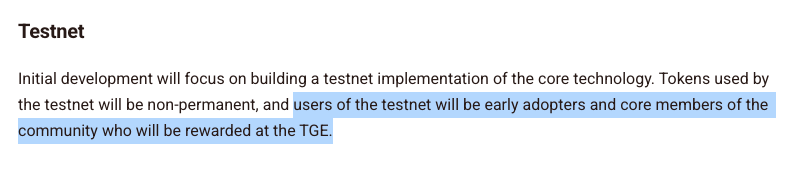

겐신은 공식 라이트페이퍼를 통해 TGE 계획을 명시한 바 있으며, 테스트넷 초기 사용자와 커뮤니티 코어 멤버에게 토큰 보상이 제공될 예정입니다.

실제로 지난 3월 18일, 겐신의 Head of Recruiting인 Emily Donald가 트위터를 통해 토큰 처리를 담당할 Head of Finance를 모집한다는 포스팅을 게재하면서 겐신 TGE가 얼마 남지 않았다는 기대감을 불러일으킨 바 있습니다.

현재로서는 일반 사용자가 겐신에 참여할 수 있는 대표적인 방법은 겐신의 분산 강화학습 프레임워크 RL Swarm과 repops-demo 두 가지를 구동하는 것으로 알려져 있고, 겐신의 깃허브를 통해 참여 방법을 확인할 수 있습니다. 특히 RL Swarm과 관련하여 4월 1일 출시된 테스트넷을 통하여 사용자경험을 기록하는 것이 가능합니다.

2. Ritual

현재 AI 서비스는 모델의 정확한 실행 여부를 판단할 수 있는 계산 무결성, 프라이버시 보호, 검열 저항성과 같은 핵심 요소들이 미비한 상태이며, 소수의 빅테크 기업이 제공하는 폐쇄형 API에 과도하게 의존하고 있다는 한계가 존재합니다. 이러한 구조는 개발자와 사용자가 AI를 투명하고 지속 가능한 방식으로 활용하는 데 제약으로 작용하고 있습니다.

리츄얼(Ritual)은 이러한 문제의식에 기반하여, 블록체인을 중심으로 한 탈중앙화 개방형 AI 인프라 구축을 목표로 하고 있습니다. 누구나 허가 없이 AI 모델을 생성, 공유, 확장할 수 있도록 설계된 모듈형 분산 AI 실행 레이어를 통해, 리츄얼은 AI 기술의 소유권과 운영 주체를 분산화하고, 이를 통해 생태계 전반의 접근성과 자율성을 회복하고자 합니다.

2.1. 주요 서비스 및 성과

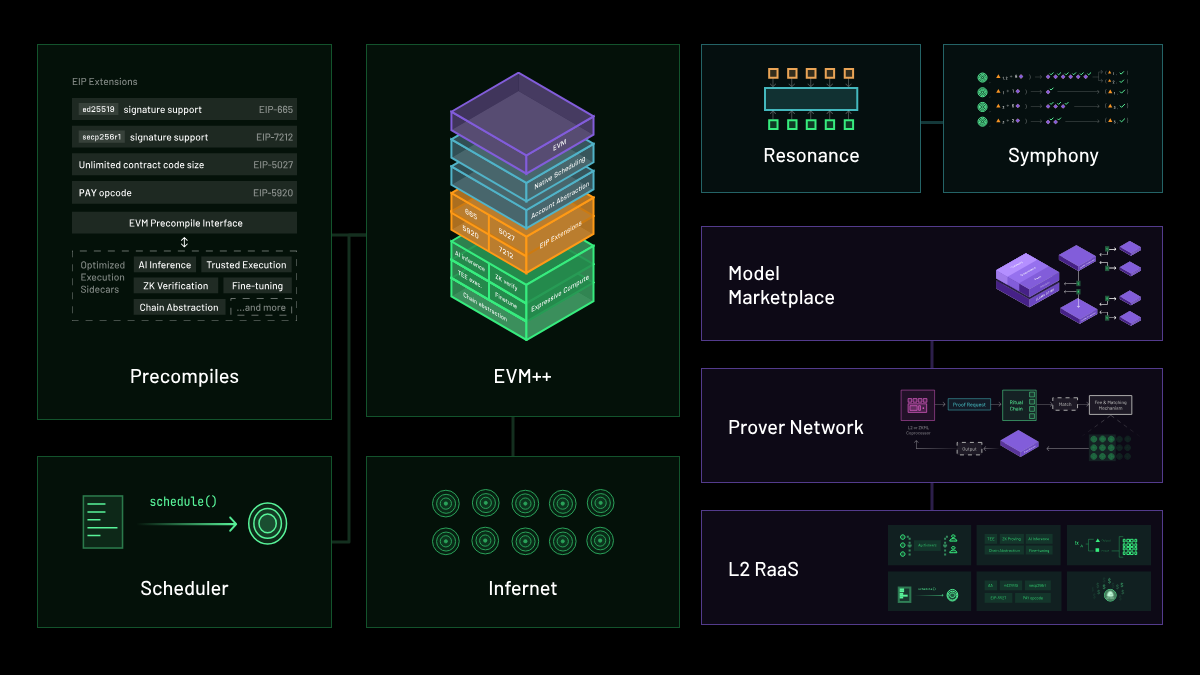

리츄얼의 핵심 구성은 크게 레이어 1 프로토콜인 리츄얼 체인(Ritual Chain)과, AI 추론에 특화된 탈중앙화 오라클 네트워크인 인페르넷(Infernet)으로 구분됩니다.

AI 연산에 최적화된 레이어 1, 리츄얼 체인

EVM 호환 커스텀 가상머신을 기반으로 구축된 네트워크인 리츄얼 체인은 AI 및 특수 연산에 최적화된 네트워크로, 체인 자체에 AI 모델 추론 및 미세 조정 등의 기능이 통합되어 있습니다. 또한, 리츄얼 체인은 타 레이어 1 및 롤업 네트워크와 공존하는 모듈형 실행 레이어로 설계되었기 때문에, 다양한 네트워크 상의 애플리케이션에서 자유롭게 리츄얼 체인을 통해 연산을 수행할 수 있습니다.

AI 특화 오라클 네트워크, 인페르넷

인페르넷(Infernet)은 리츄얼에서 출시한 AI 추론 작업에 특화된 최초의 탈중앙화 오라클 네트워크로, 2023년 11월 출시 이후 현재 8,000여 개의 독립적인 노드로 구성되어 있습니다. 각 노드는 다양한 하드웨어 프로필과 능력을 기반으로 요청을 수행할 수 있습니다.

인페르넷의 핵심은 탈중앙화와 투명성으로, 기존 중앙화된 API 서비스와 달리 인페르넷은 무신뢰 네트워크 구조를 통해 AI 연산을 수행하며, 이는 데이터의 프라이버시와 검증 가능성을 보장합니다. 또한, 인페르넷은 스트리밍 응답 지원, 온체인 결제 및 검증 기능 등을 포함하여 사용자들에게 효율적이고 신뢰할 수 있는 추론 환경을 제공합니다.

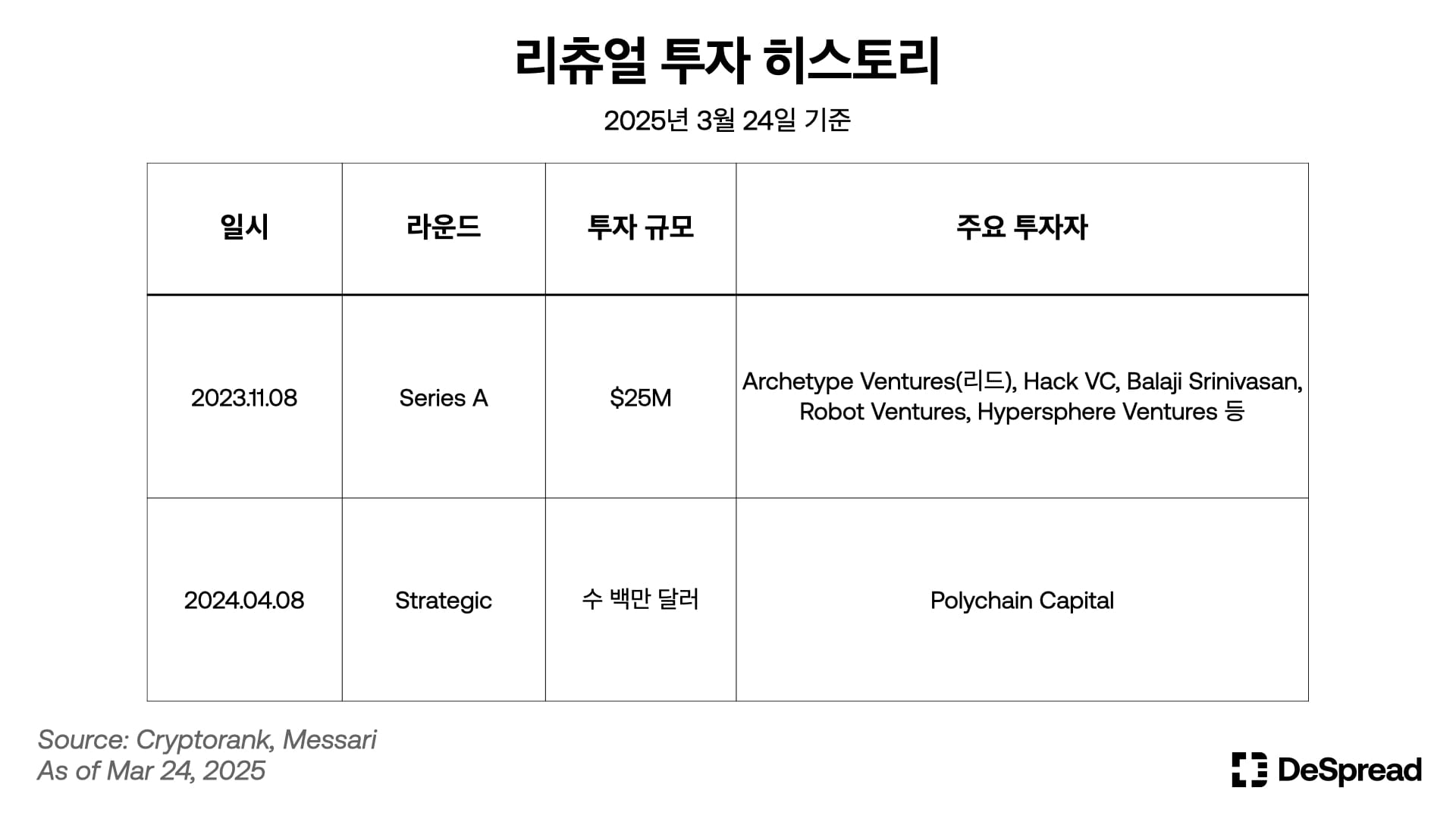

2.2. 투자 히스토리

리추얼은 지금까지 두 번의 투자 라운드를 통해 주목할 만한 성과를 이루어냈습니다. 2023년 11월 8일, 시리즈 A 라운드에서 Archetype Ventures의 리드로 $25M 모집에 성공하였으며, 해당 라운드에는 최근 높은 투자 퍼포먼스로 주목을 받고 있는 Hack VC도 참여하였습니다.

이어, 2024년 4월 8일에는 Polychain Capital으로부터 추가 투자 유치에 성공하였으며, 구체적인 금액은 공개되지 않았으나 수 백만 달러로 추정되고 있습니다.

2.3. 팀 백그라운드

Niraj Pant, 코파운더

Akilesh Potti, 코파운더

두 코파운더 외에도 Illia Polosukhin, Arthur Hayes, Sreeram Kannan 등 크립토 산업의 여러 유명인사가 리츄얼의 어드바이저에 포함되어 있습니다.

2.4. TGE 대비 전략

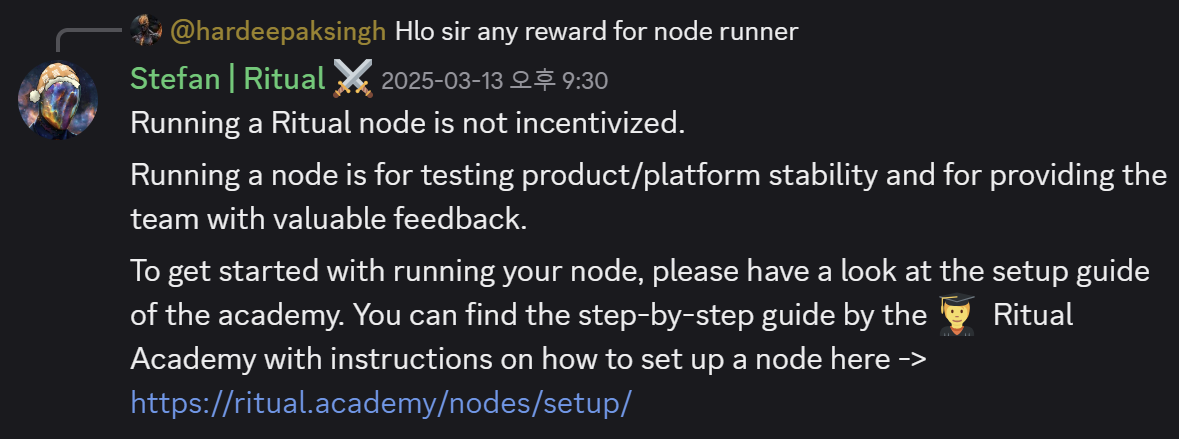

리츄얼 체인은 현재 비공개 테스트넷 단계에 있으며, 일반 사용자는 인페르넷 노드 구동을 통해 리츄얼 생태계에 참여해 볼 수 있습니다.

다만, 리츄얼 팀은 해당 노드 운영에 대한 보상이 없을 것이라고 밝혔기 때문에, 이 활동이 반드시 토큰 보상으로 이어지지는 않을 수 있습니다.

3. Hyperbolic

하이퍼볼릭(Hyperbolic)은 중앙화된 클라우드 AI 서비스의 높은 비용과 낮은 신뢰성 문제를 해결하기 위해 등장한 프로젝트로, 전 세계 유휴 GPU를 하나로 모은 ‘Open Access AI Cloud’를 구축하여 누구나 자유롭게 컴퓨팅 파워를 활용할 수 있도록 하는 것을 목표로 합니다.

3.1. 주요 서비스 및 성과

탈중앙화 GPU 마켓 플레이스와 AI 추론

하이퍼볼릭의 핵심 프로덕트 중 하나는 전 세계에 분산된 유휴 GPU 자원을 모아, 컴퓨팅 파워가 필요한 AI 개발자들이 저렴한 비용으로 원하는 만큼 사용할 수 있도록 지원하는 탈중앙화 GPU 마켓플레이스입니다.

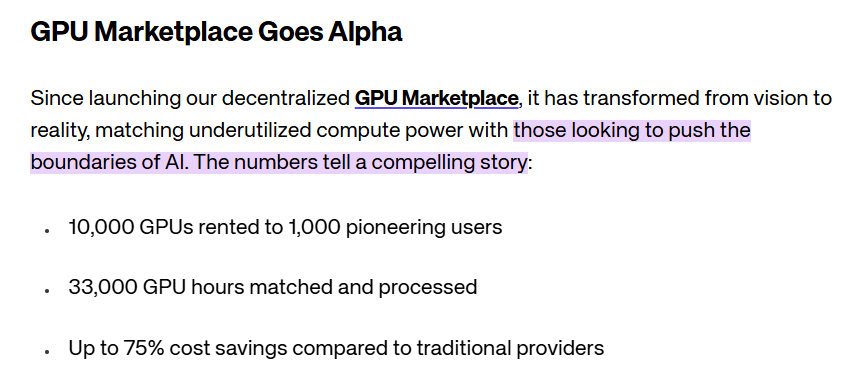

사용자는 하이퍼볼릭의 마켓플레이스를 통해 전통 클라우드 서비스 대비 최대 75%까지 비용을 절감할 수 있으며, 수 분 내에 GPU를 제공받을 수 있습니다. 현재 GPU 마켓플레이스는 알파 단계를 성공적으로 마친 이후 베타 단계에 돌입하였으며, 2025년 1월 기준 1,000명 이상의 유저가 10,000개 이상의 GPU를 임대하여 33,000 시간 이상의 연산 작업을 수행하는 등 초반부터 높은 성과를 기록하고 있습니다.

하이퍼볼릭의 또 다른 핵심 프로덕트는 자체 검증 기술인 PoSP(Proof-of-Sampling)를 기반으로 한 AI 추론 서비스입니다. PoSP는 모든 트랜잭션을 검증하는 대신 무작위로 샘플링된 트랜잭션만을 확인하여 전체 추론 결과의 신뢰성을 확보하는 메커니즘으로, 계산 비용을 크게 절감할 수 있습니다. 현재 하이퍼볼릭은 약 40,000명 규모의 개발자 커뮤니티를 보유하고 있으며, 하루 10억 토큰 이상의 AI 추론을 처리할 정도로 대규모로 활용되고 있습니다.

웹2와 웹3를 아우르는 파트너십

하이퍼볼릭은 출범 이후 웹2와 웹3를 넘나들며 다양한 기업과 파트너십을 맺으며 기술력을 입증하고 있습니다. 특히, AI와 머신러닝 분야에서 두각을 나타내고 있는 웹2 기업인 Hugging Face와 협력하여 추론을 제공하고 있으며, 이외에도 Quora의 Poe, OpenRouter, MyShell 등과 연계하여 하이퍼볼릭의 저렴한 AI 추론 API를 이들 서비스 사용자들이 직접 활용할 수 있도록 통합하고 있습니다.

또한, 하이퍼볼릭은 학계 및 연구기관과의 협력도 적극적으로 이어가고 있습니다. Stanford, Cornell, UC Berkeley, NYU 등 세계 유수의 대학 연구진들이 하이퍼볼릭의 분산 GPU 네트워크를 활용해 대규모 AI 모델을 연구 중이며, 하이퍼볼릭 팀은 UC Berkeley 및 Columbia와 함께 보다 효율적인 검증 메커니즘인 PoSP 프로토콜을 공동 개발하기도 했습니다.

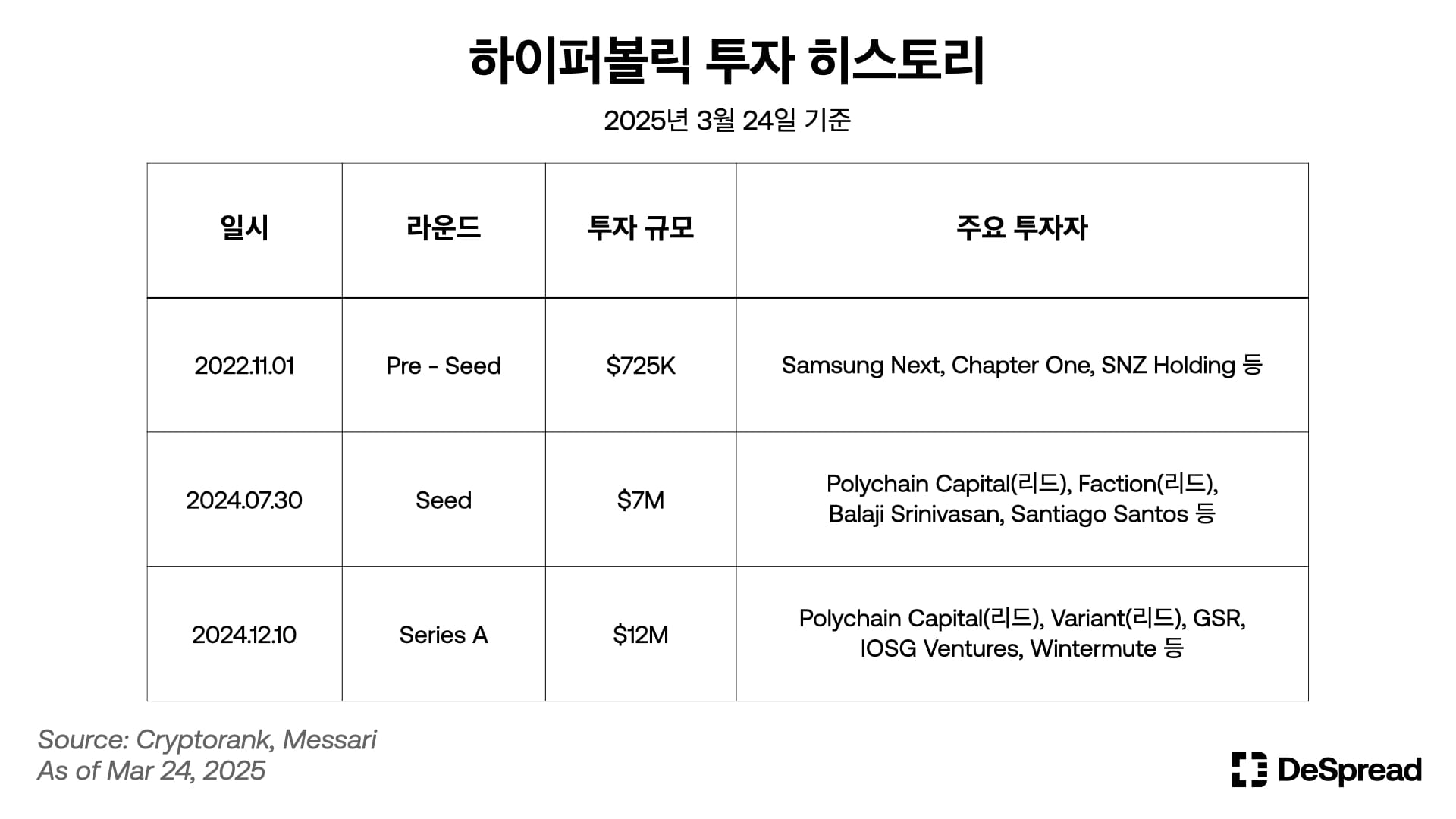

3.2. 투자 히스토리

하이퍼볼릭은 현재까지 세 번의 라운드를 통해 약 $20M에 달하는 금액을 모집하였습니다. 2024년 7월 30일 이루어진 $7M 규모의 시드 라운드에는 Polychain Capital의 리드 참여와 더불어 Balaji, Santiago 등 유명 엔젤 투자자들이 참여하였습니다. 이어 2024년 12월 10일 이루어진 시리즈 A 라운드에서는 $12M을 모집하였으며 Polychain의 리드로 Variant, GSR, Wintermute 등 업계를 대표하는 VC들의 투자를 받았습니다.

3.3. 팀 백그라운드

Jasper Zhang, 코파운더

Yuchen Jin, 코파운더 & CTO

Raluca Ada Popa, 어드바이저

3.4. TGE 대비 전략

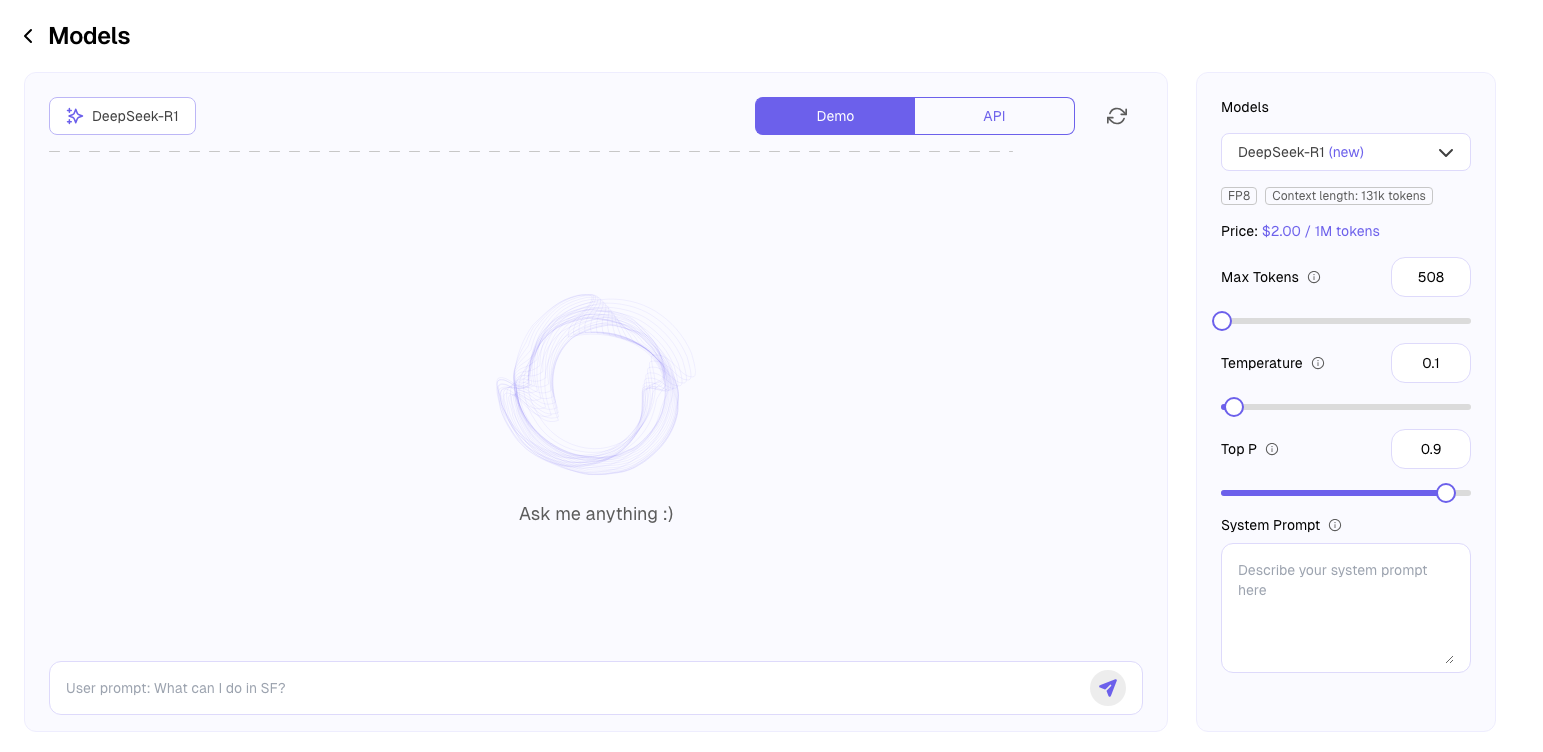

현재 하이퍼볼릭 홈페이지에서 하이퍼볼릭에 기여할 수 있는 활동은 ‘Models’, ‘Rent GPU’, ‘Supply GPU’로 총 3개가 존재합니다. 이 중, Supply GPU는 웨잇리스트를 받고 있는 상태로, 대부분의 일반 유저는 참여하기 어렵기 때문에 Models와 Rent GPU에 주목할 필요가 있습니다.

Models는 DeepSeek-R1, Llama-3.3 등 하이퍼볼릭에서 제공하는 다양한 LLM(Large Language Model)을 활용할 수 있는 탭입니다. 텍스트 모델, 이미지 모델, VLM(Vision Language Model) 모델, 베이스 모델, 오디오 모델까지 총 5가지 종류의 모델들이 존재하며 사용자는 크레딧을 충전하여 해당 모델에게 질문을 하는 등 상호작용을 통해 기록을 남길 수 있습니다.

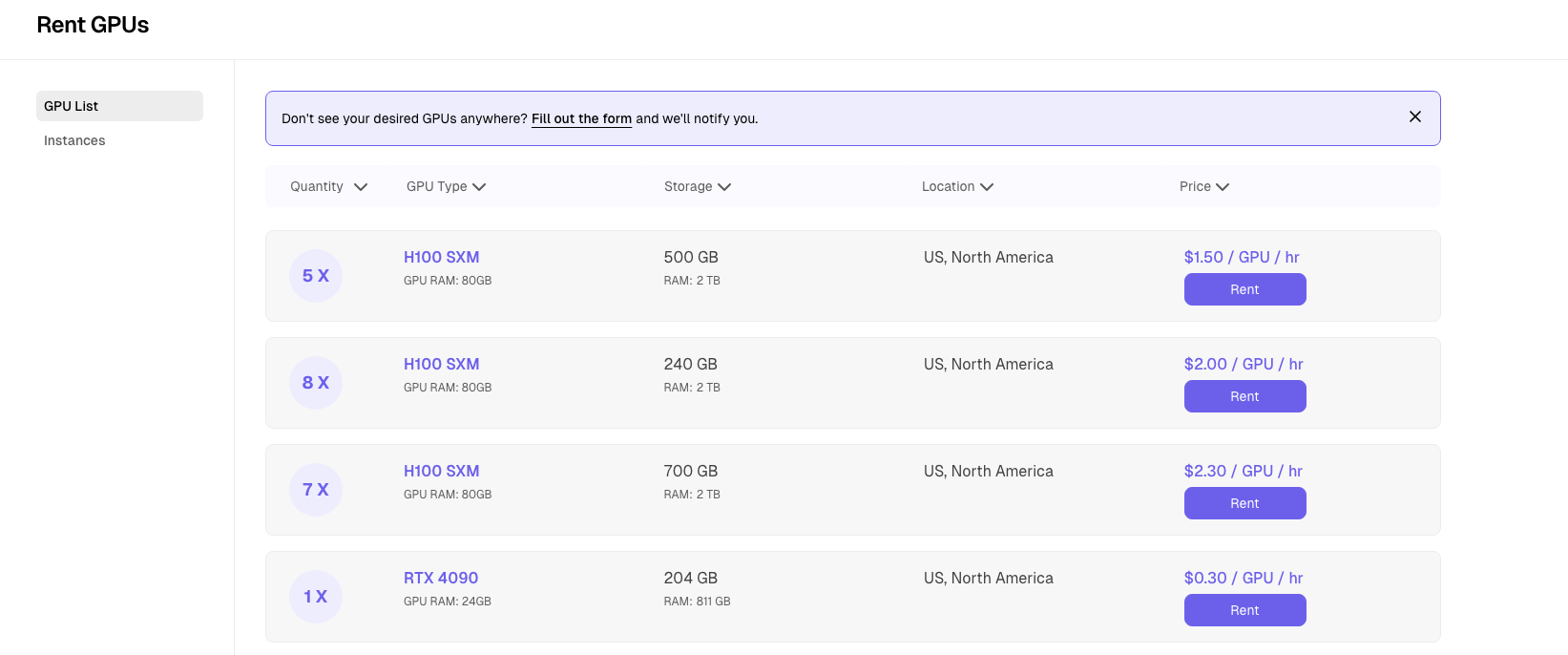

Rent GPU는 하이퍼볼릭에 공급되어 있는 GPU를 결제하고 실제로 임대할 수 있는 탭입니다. GPU 개수와 종류에 따라 시간당 가격은 $2.3부터 $0.3까지 다양하게 분포되어 있으며, Models 탭과 동일하게 사용자는 크레딧을 충전하여 GPU를 임대 및 사용할 수 있습니다.

크레딧은 ‘Billing’ 탭에서 충전할 수 있으며 Stripe를 통해 법정화폐 결제는 물론 Base 네트워크에서 스테이블코인을 통한 크립토 결제도 지원하고 있습니다.

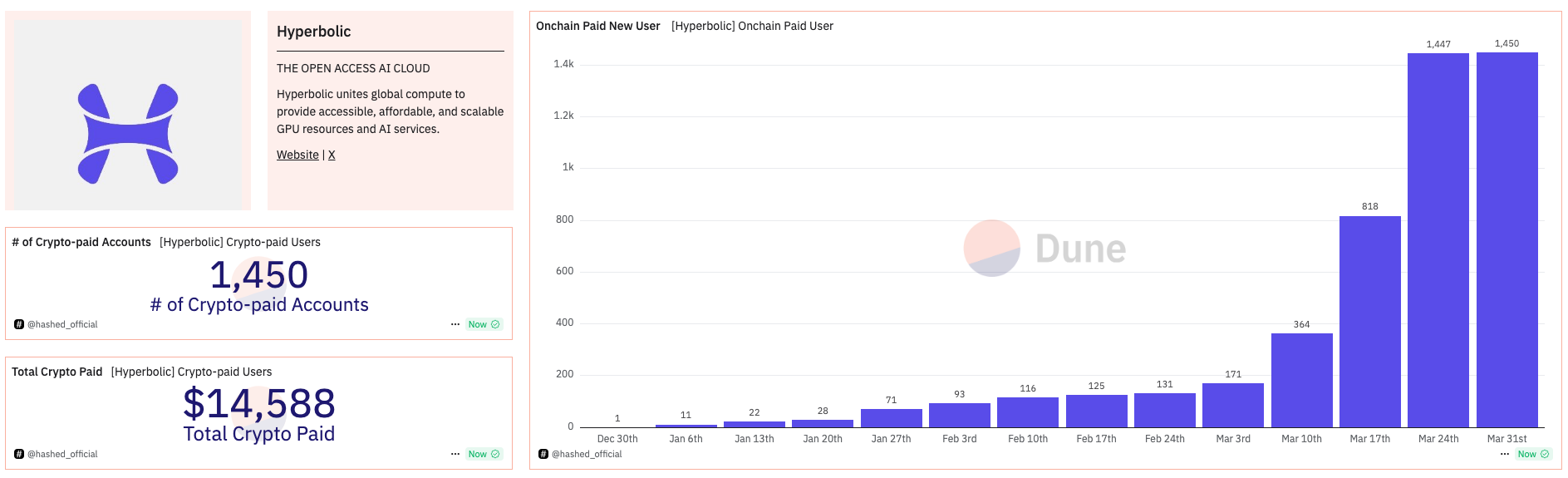

Hashed의 듄 대시보드에 따르면, 하이퍼볼릭에서 온체인으로 결제한 계정은 3월 3일 171명에서 3월 31일 1,450명으로 8.5배 가량 증가하였으며, 총 결제된 크립토 금액은 $14,600에 육박하는 등 하이퍼볼릭이 웹3 유저들에게 높은 관심을 받고 있습니다.

4. Prime Intellect

프라임 인텔렉트(Prime Intellect)는 컴퓨팅 자원의 중앙집중화 및 고비용 문제를 해결하기 위해 등장한 프로젝트로, 전 세계에 분산된 GPU를 하나의 P2P 네트워크로 연결해 누구나 AI 모델 개발에 참여하고 그 성과를 공유할 수 있는 생태계를 구축하는 것을 비전으로 제시합니다.

4.1. 주요 서비스 및 성과

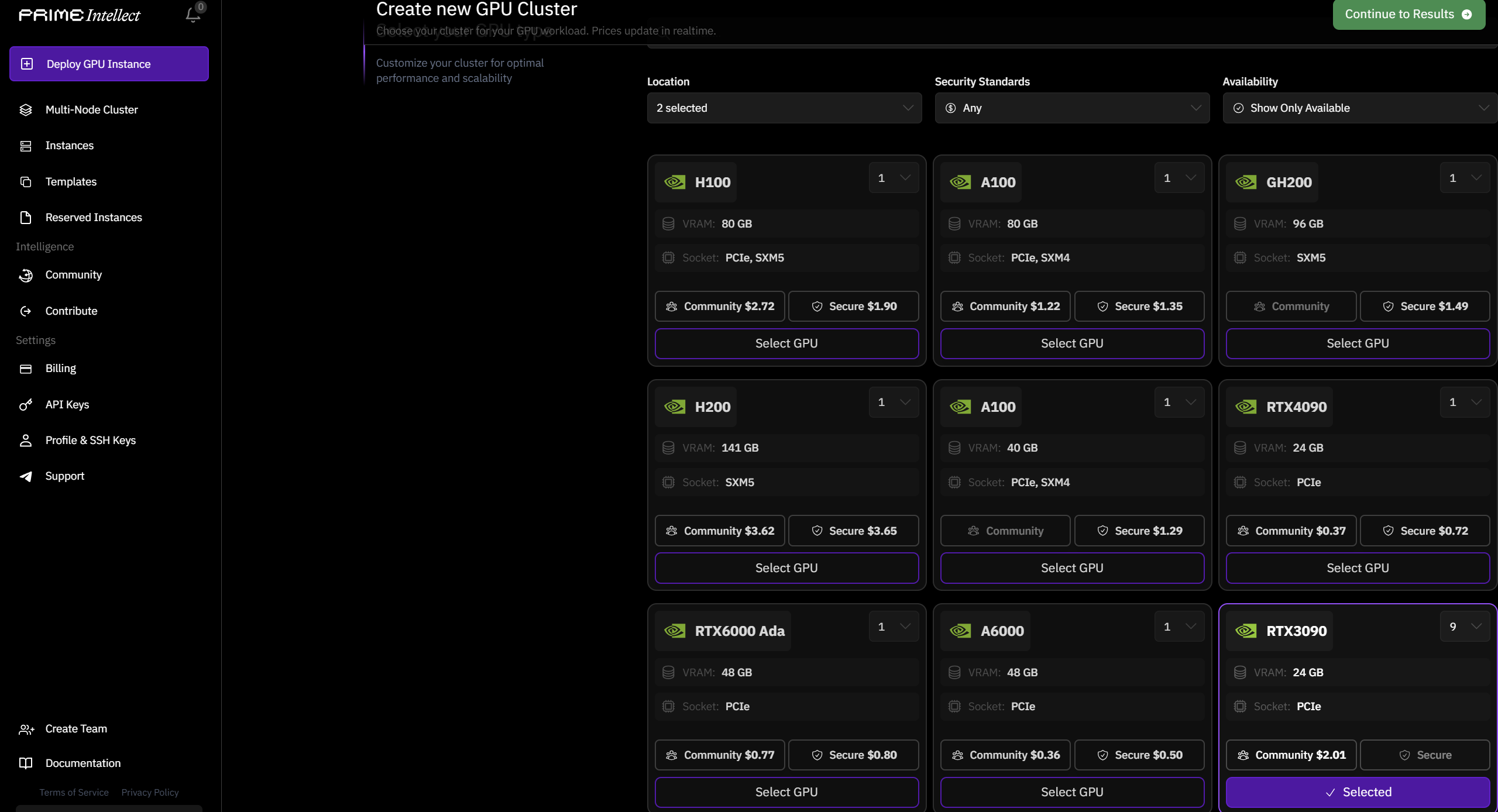

프라임 인텔렉트의 주요 서비스는 분산 GPU 마켓플레이스인 “Prime Intellect Compute”입니다. 해당 플랫폼은 전 세계 개인 GPU 보유자, 클라우드 업체, 데이터센터 등에 퍼져있는 유휴 GPU 자원을 한 곳에 모아 AI 연구 및 모델 개발에 필요한 대규모 컴퓨팅 자원을 효율적으로 제공하고 있으며, 2024년 7월 기준 12 곳 이상의 클라우드와 통합하여 저렴한 가격의 고성능 GPU를 제공하고 있습니다.

또한 프레임 인텔렉트는 2024년 10월 세계 최초로 100억 파라미터 규모의 분산 LLM 훈련을 실행하였으며, 훈련 모델인 INTELLECT-1을 전 세계 세 개의 대륙에 걸쳐 30개의 독립 노드에서 42일간 훈련하는 데 성공하였습니다. 그 결과, 탈중앙화된 환경에서도 98%에 달하는 높은 연산 효율을 달성하며 중앙화된 서버 없이도 대규모 AI 모델 학습이 가능하다는 것을 입증하였습니다.

이외에도, 프라임 인텔렉트는 업계 내 다양한 파트너들과도 협업하여 생태계를 확장하고 시너지를 도모하고 있습니다. 오픈소스 AI 기업 및 프로젝트들이 대표적인 예시로, Hugging Face, Arcee AI, Akash Network 등과 협력하여 웹2와 웹3 전반에 걸쳐 컴퓨팅 자원을 기여하고 있습니다.

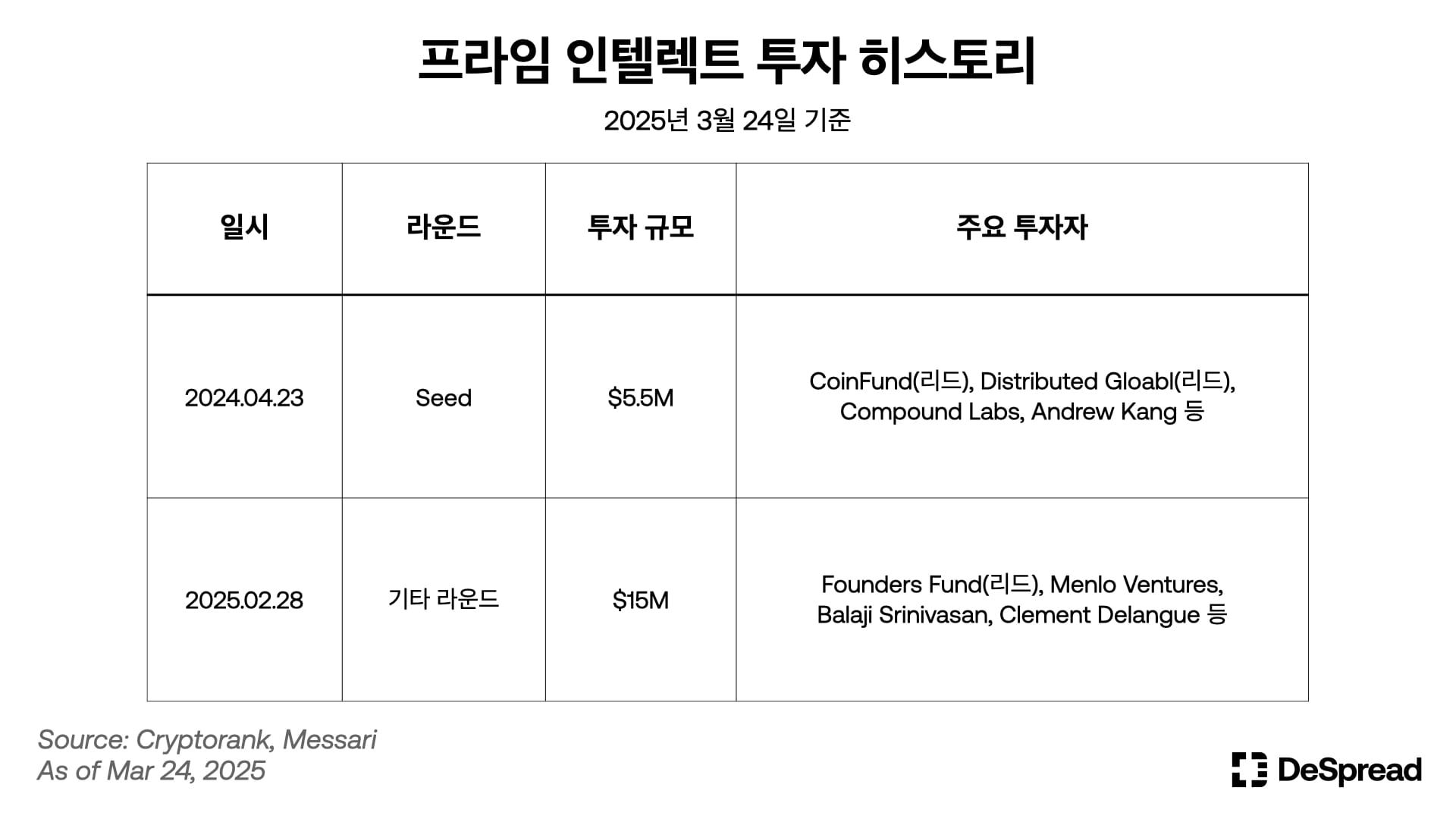

4.2. 투자 히스토리

프라임 인텔렉트는 현재까지 2번의 라운드에서 총 $20.5M 규모의 자금을 모집하였습니다. 2024년 4월 23일 시드 라운드에서는 CoinFund의 리드로 $5.5M을 모집하였으며, 유명 KOL이자 엔젤 투자자인 Andrew Kang이 참여하였습니다. 이어 2025년 2월 8일 추가 라운드를 통해 Founders Fund의 리드로 $15M을 모집하였습니다.

특히, 해당 라운드에는 AI와 머신러닝 분야에서 두각을 드러내고 있는 웹2 기업인 Hugging Face의 파운더 Clement Delangue, 이미지 생성 모델 Stable Diffusion으로 널리 알려진 Stability AI의 파운더 Emad, 그리고 OpenAI의 창립 멤버이자 Tesla의 전 AI 디렉터였던 Andrej Karpathy로부터 엔젤 투자를 받으며 프라임 인텔렉트의 잠재력이 웹3를 넘어 웹2까지 인정받았다는 평가를 받고 있습니다.

4.3. 팀 백그라운드

Vincent Weisser, 코파운더 & CEO

Johannes Hagemann, 코파운더 & CTO

4.4. TGE 대비 전략

현재 일반 사용자가 프라임 인텔렉트에 기여할 수 있는 방법은 GPU 마켓에서 GPU를 임대하여 사용하는 것이 유일합니다. 다만, 프라임 인텔렉트와 유사한 탈중앙화 GPU 네트워크 프로토콜인 아이오넷(Io.net)의 사례를 참고하면, TGE 당시 GPU 사용자에게 별도의 보상이 지급되지 않았던 전례가 있어, 프라임 인텔렉트 역시 GPU를 사용하더라도 반드시 보상이 주어진다고 기대하기는 어렵습니다.

5. Kuzco

쿠즈코(Kuzco)는 전 세계에 분산된 유휴 GPU 자원을 효과적으로 활용하기 위해 시작된 프로젝트로, 방치된 컴퓨팅 파워를 모아 AI 추론에 활용할 수 있는 탈중앙화 GPU 네트워크 구축을 목표로 합니다. 궁극적으로는 AI 모델 추론 비용을 획기적으로 낮춰, AI 기술의 보편화를 촉진하고 현실 세계에 실질적인 기여를 하겠다는 비전을 지니고 있습니다.

5.1. 주요 서비스 및 성과

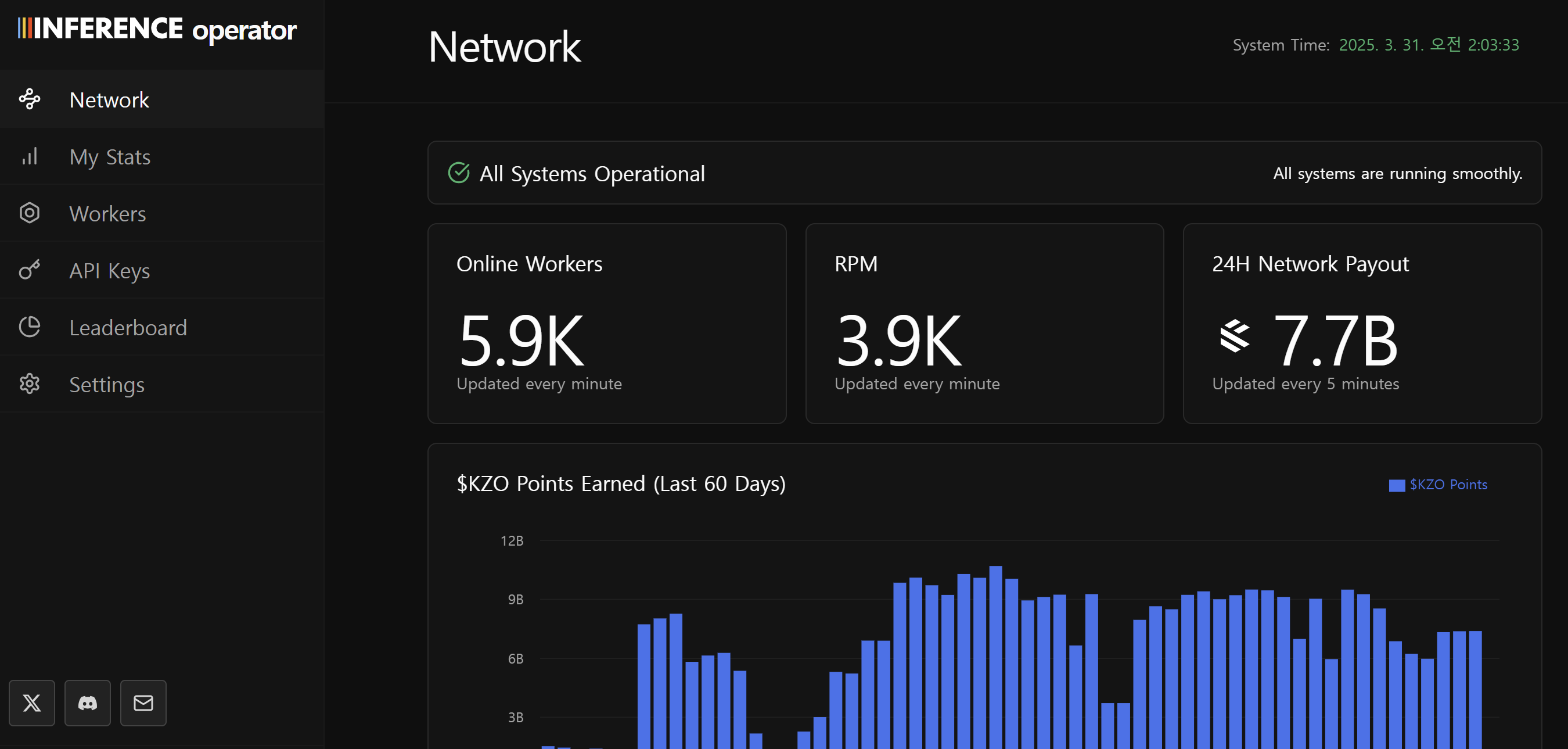

쿠즈코는 전 세계에 분산된 GPU 제공자와 AI 모델 구축을 위한 데이터 수요자를 연결하는 플랫폼으로, Llama2, Mistral 등과 같은 LLM을 저렴한 비용으로 실행할 수 있도록 지원합니다. 데이터 수요자는 쿠즈코가 제공하는 OpenAI 호환 API를 통해 해당 모델들을 자유롭게 호출할 수 있으며, GPU 공급자는 컴퓨팅 파워를 제공한 대가로 $KZO 포인트를 획득할 수 있습니다.

쿠즈코는 초기 테스트 단계부터 빠른 성장세를 보이고 있습니다. 2024년 퍼블릭 베타에서는 이미 1,400개 이상의 GPU가 가동되었고, 2025년 현재는 4배 이상 증가한 6,000여 개의 GPU가 쿠즈코 네트워크에 연결되어 총 98TB에 달하는 VRAM 용량을 제공하고 있습니다. 더불어, 자체 개발한 스케줄링(scheduling) 기술을 통해 단일 GPU 기준 90% 이상의 높은 활용률을 달성했으며, 이를 통해 최대 90% 저렴한 AI 추론 비용을 제공할 수 있다고 주장합니다.

또한, 지난 1월에는 쿠즈코가 솔라나를 활용해 GPU 네트워크를 구축한 방식을 주제로 솔라나 재단과 함께 AMA를 진행하며 생태계 참여자들로부터 높은 관심을 받았습니다.

5.2. 투자 히스토리

2024년 9월 9일, 쿠즈코는 a16z의 엑셀러레이터 프로그램인 a16z CSX(Crypto Startup Accelerator)를 통해 $500K를 유치했습니다. 또한, 쿠즈코의 홈페이지에 따르면, 투자 시점과 규모는 명확히 공개되지 않았으나 Multicoin Capital, Topology Ventures 등으로부터도 투자를 받은 것으로 확인됩니다.

5.3. 팀 백그라운드

Sam Heutmaker, 코파운더 & CEO

Ibrahim Ahmed, 코파운더 & CTO

5.4. TGE 대비 전략

쿠즈코는 2025년 6월 이후로 예정된 TGE를 앞두고, 현재 메인넷 출시 전 단계인 인센티브 테스트넷을 운영하며 초기 기여자들에게 $KZO 포인트를 지급하는 방식으로 네트워크 참여를 유도하고 있습니다. 사용자는 자신이 보유한 GPU를 활용하거나, VAST.AI 등의 플랫폼을 통해 GPU를 임대하여 inference.supply에 공급함으로써 포인트를 획득할 수 있습니다.

6. Chainbase

현재 블록체인 산업에는 수십 개의 체인이 등장하면서 온체인 데이터가 매우 분산된 상태이며, 이로 인해 데이터셋을 개발하고 구조화하는 데 상당한 리소스가 낭비되고 있는 상황입니다. 체인베이스(Chainbase)는 이러한 문제를 해결하기 위해 등장한 옴니체인(Omnichain) 데이터 네트워크로, 수많은 네트워크에 흩어진 온체인 데이터를 통합하여 AI 시대에 최적화된 데이터 레이어를 구축하는 것을 목표로 합니다.

6.1. 주요 서비스 및 성과

체인베이스는 다양한 네트워크의 온체인 데이터를 통합하는 옴니체인 데이터 네트워크로, 웹3 생태계의 핵심 데이터 인프라를 제공합니다. 주요 서비스는 다음과 같습니다.

데이터 스트리밍 프레임워크, 매뉴스크립트

매뉴스크립트(Manuscript)는 온체인 및 오프체인 데이터를 자유롭게 통합하여 실시간으로 처리하고 분석할 수 있는 환경을 제공합니다. 가장 큰 장점은 높은 접근성입니다. 매뉴스크립트는 다양한 프로그래밍 언어, 인터페이스, 데이터 형식을 지원하여 개발자들이 복잡한 멀티체인 데이터도 손쉽게 가공할 수 있도록 돕습니다.

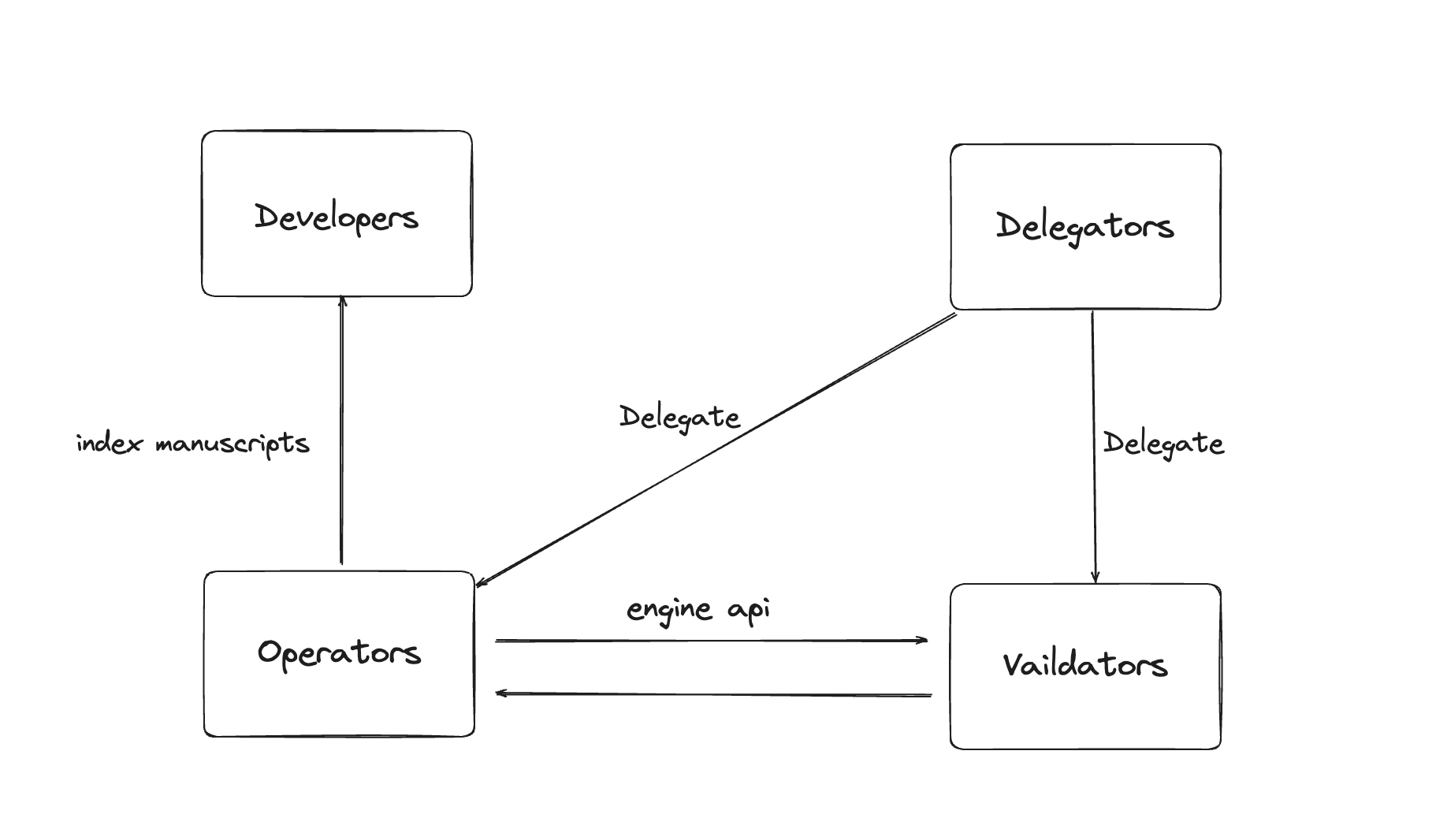

옴니체인 데이터 네트워크, 체인베이스 네트워크

체인베이스 네트워크는 개발자(Developer), 운영자(Operator), 검증자(Validator), 위임자(Delegator)로 구성되어 있으며, 각 역할은 다음과 같습니다:

- 개발자: 데이터의 수요와 공급을 담당하며, 매뉴스크립트를 통해 데이터를 처리하고 보상을 수령

- 운영자: 실행 레이어(Execution Layer)에서 데이터 처리 작업을 위한 컴퓨팅 자원을 제공하고 보상 수령

- 검증자: CometBFT를 개선한 합의 프로토콜을 활용하며, DPoS(Delegated Proof-of-Stake)에 따라 스테이킹된 $C 토큰 규모에 비례해 투표 가중치가 결정됨

- 위임자: 검증자에게 $ETH 또는 $C를 위임하여 네트워크의 경제적 보안에 기여

산업 내 활발한 파트너십

체인베이스는 현재 EigenLayer, Carv, Gaia 등 다양한 웹3 프로젝트 및 기업과 파트너십을 맺으며 탈중앙화 데이터 인프라 허브로서의 입지를 빠르게 확장하고 있습니다. 특히 지난 3월, Mysten Labs의 데이터 스토리지 프로토콜 Walrus와의 협업을 통해 220개 이상의 네트워크에서 생성된 300TB 규모의 데이터를 저장할 수 있는 파이프라인 구축 계획을 공개하며 시장의 높은 관심을 받았습니다.

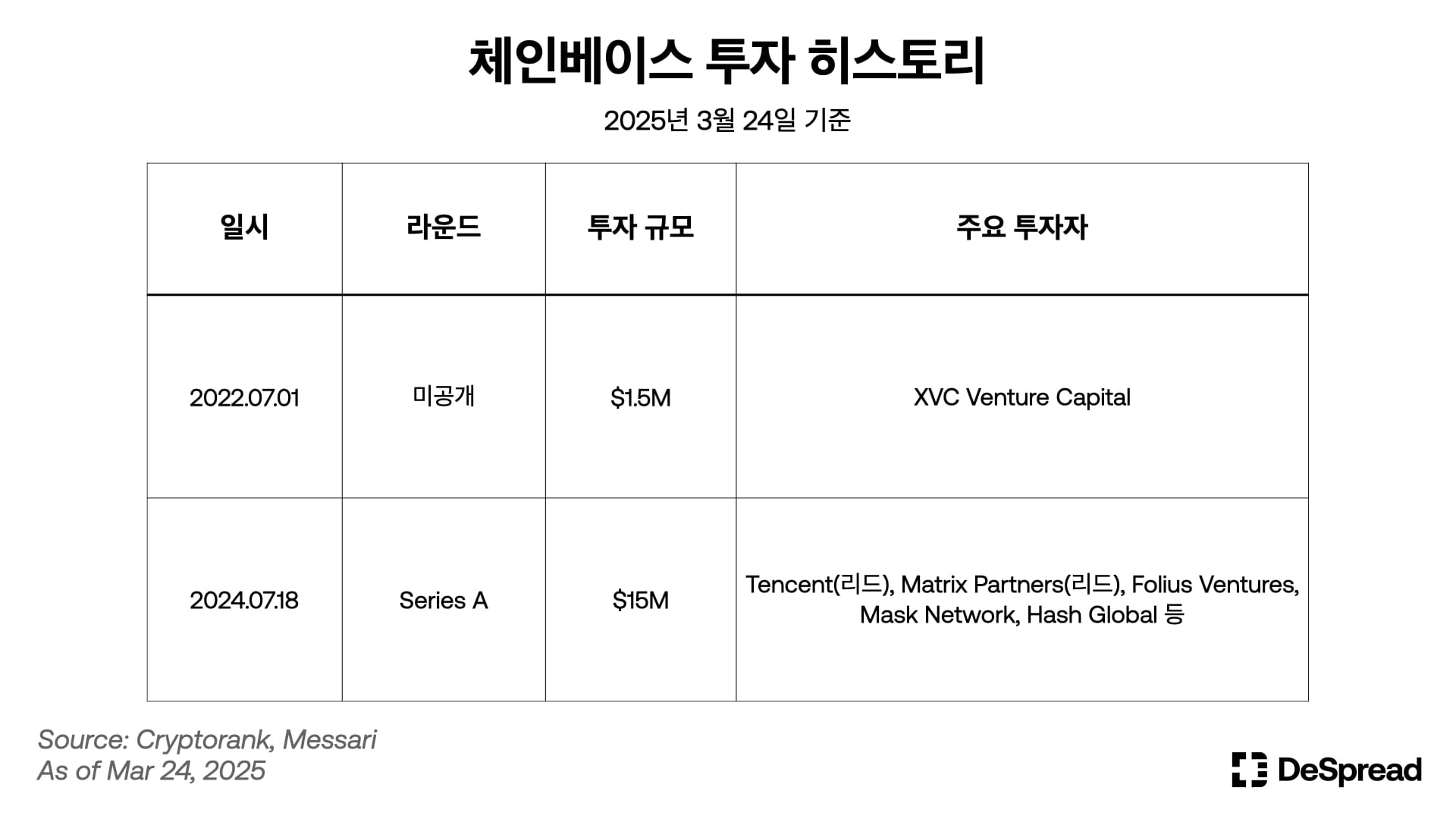

6.2. 투자 히스토리

체인베이스는 현재까지 두 차례 라운드에서 총 $16.5M 규모의 자금을 모집하였습니다. 2022년 7월 1일 미공개 라운드에서 XVC Venture Capital로부터 $1.5M을 투자받았으며, 2024년 7월 18일에는 Tencent와 Matrix Partners의 리드로 $15M 투자 유치에 성공하였습니다.

6.3. 팀 백그라운드

Chris Feng, 코파운더 & COO

체인베이스의 코파운더이자 COO를 맡고 있는 Chris Feng은 경영 컨설팅, 해외 M&A, 벤처 캐피털 투자 등 금융 산업을 중심으로 커리어를 키워왔으며, 현재 체인베이스에서 커뮤니티 빌딩, 마케팅, 에코시스템 그로스 등 기술 외적의 모든 업무를 담당하고 있습니다.

6.4. TGE 대비 전략

체인베이스의 네이티브 토큰 $C는 데이터 처리 비용 지불, 스테이킹, 참여자 인센티브 등 다양한 용도로 활용되며, 체인베이스 네트워크의 경제적 보안과 지속 가능성을 뒷받침하는 핵심 요소입니다.

2024년 8월 16일, 체인베이스는 제네시스 캠페인을 통해 미션 기반 에어드랍 이벤트를 진행했습니다. 사용자가 테스트넷에 지갑을 연결하고 챗봇을 이용하는 등의 작업을 수행하면, 추후 토큰 보상에 활용 가능한 포인트나 NFT를 획득할 수 있었습니다.

다만, 제네시스 캠페인은 현재 만료된 상태이며 일반 사용자 입장에서 체인베이스에 기여할 수 있는 방법으로는 화이트리스트 등록을 통해 체인베이스 AVS 테스트넷 오퍼레이터를 구동하는 방법만이 남아있는 상황입니다.

7. 마치며

디파이, NFT, 메타버스 등 다양한 메타들이 등장하고 사라져 온 과정을 우리는 이미 여러 차례 경험해 왔습니다. 당시에는 주목받았던 많은 프로젝트들이 시간이 흐르면서 점차 시장에서 사라졌고, 이러한 사례들은 현재 우리가 마주한 AI 메타를 바라보는 데 있어 하나의 참고 지점이 될 수 있습니다.

최근 전 세계적으로 AI에 대한 관심이 빠르게 확산되며, 매일 새로운 AI 기반 프로젝트들이 등장하고 있습니다. 하지만 이 가운데에서 실제 사용성과 지속 가능성을 갖춘 프로젝트를 선별하는 일은 이전보다 더 중요해졌습니다.

본 아티클에서는 최근 시장의 주목을 받고 있는 블록체인과 AI를 결합한 6가지 프로젝트에 대해 살펴보았으며, 투자자이자 사용자로서 이들의 TGE에 대비할 수 있는 실질적인 전략을 함께 제안하였습니다.

물론 본문에 소개된 프로젝트 외에도 다양한 신규 프로젝트들이 지속적으로 등장할 것으로 예상됩니다. 이럴 때일수록 단기적인 흐름에만 주목하기보다는, TGE 이후에도 의미 있는 사용 사례와 생태계 내 역할을 지속적으로 확장해 나갈 수 있는 프로젝트에 대해 고민해 보는 태도가, 보다 장기적인 관점에서 안정적인 투자로 이어질 수 있다고 생각합니다.